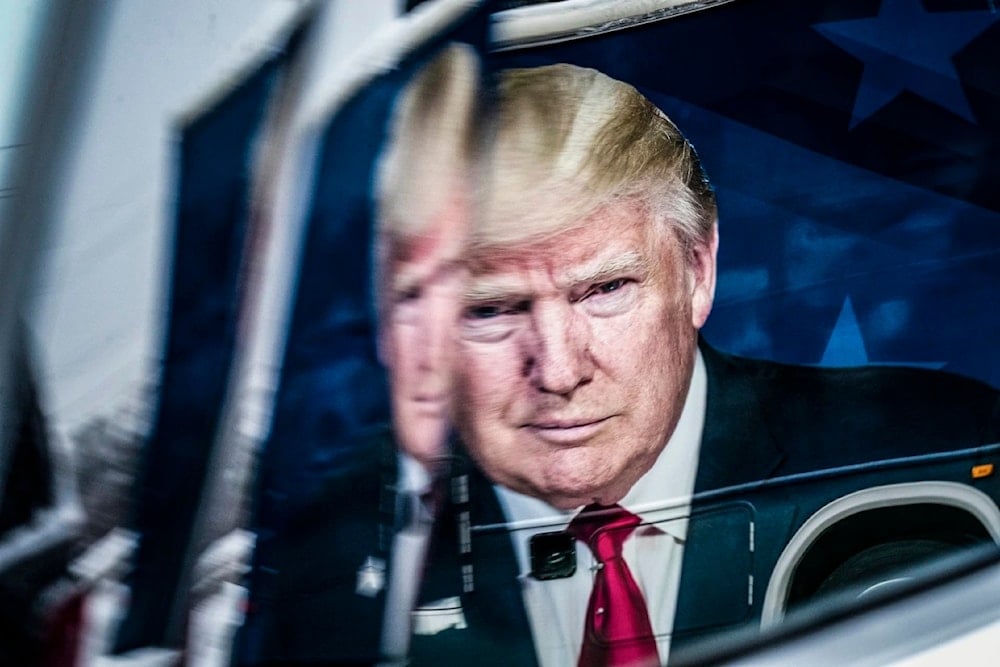

"Wired": فوز ترامب في الانتخابات قد يُطلق العنان للذكاء الاصطناعي المحفوف بالمخاطر

قد تؤدي معارضة دونالد ترامب لمعايير السلامة "الواعية" الخاصة بالذكاء الاصطناعي إلى إلغاء القوانين التي تحمي الأميركيين من المعلومات المضلّلة والتمييز وما هو أسوأ من ذلك.

-

فوز ترامب في الانتخابات الرئاسية قد يطلق العنان للذكاء الاصطناعي المحفوف بالمخاطر

مجلة "wired" الأميركية تنشر تقريراً للصحافي إريك غيلر، المتخصص بتغطية الشؤون المتعلقة بالأمن السيبراني والتكنولوجيا، تحدث فيه عن خطة ترامب بشأن إلغاء أمر تنفيذي صادر عن الرئيس جو بايدن، لتنظيم الذكاء الاصطناعي.

أدناه نص المقال منقولاً إلى العربية بتصرف:

في حال فاز دونالد ترامب بالانتخابات الرئاسية الأميركية في تشرين الثاني/نوفمبر، فقد يخرج مسار تطوير الذكاء الاصطناعي عن حواجز الحماية، وخصوصاً مع تزايد خطورة نماذج الذكاء الاصطناعي الفاسدة.

إنّ انتخاب ترامب لولاية رئاسية ثانية من شأنه أن يعيد تشكيل أو حتى عرقلة الجهود الرامية إلى حماية الأميركيين من المخاطر المتعددة التي يفرضها الذكاء الاصطناعي المصمم بشكل رديء، بما في ذلك المعلومات المضللة والتمييز وإلحاق الضرر بالخوارزميات المستخدمة في التكنولوجيا مثل المركبات ذاتية القيادة.

بدأت الحكومة الفيدرالية الإشراف على شركات الذكاء الاصطناعي وتقديم المشورة إليها بموجب أمر تنفيذي صادر عن الرئيس جو بايدن في تشرين الأول/أكتوبر 2023، إلّا أنّ ترامب تعهد إلغاء هذا الأمر، مشيراً إلى أنه "يعوّق الابتكار في مجال الذكاء الاصطناعي" و"يفرض أفكاراً يسارية متطرفة" على تطور الذكاء الاصطناعي.

أثار وعد ترامب الحماسة في نفوس منتقدي هذا الأمر التنفيذي الذين يعدّونه غير قانوني وخطيراً، ويرونه عائقاً أمام سباق التسلّح الرقمي بين الولايات المتحدة والصين. وأكثر هؤلاء المنتقدين هم حلفاء ترامب المقربون، من الرئيس التنفيذي لشركة "إكس" إيلون ماسك وصاحب رأس المال المغامر مارك أندريسن، إلى الأعضاء الجمهوريين في الكونغرس، ونحو عشرين من المدعين العامين التابعين للحزب الجمهوري. كذلك، يعارض نائب ترامب، السيناتور جيه دي فانس عن ولاية أوهايو، بشدة تنظيم الذكاء الاصطناعي.

وفي هذا السياق، قال جايكوب هيلبيرغ، وهو أحد التنفيذيين التقنيين ومتحمس للذكاء الاصطناعي، والذي يطلق عليه لقب "إبليس ترامب في وادي السيليكون": "لا يرغب الجمهوريون في التسرع في الإفراط في تنظيم هذا القطاع".

لكن خبراء التكنولوجيا والأمن الإلكتروني يحذرون من أنّ إلغاء الأحكام المتعلقة بالسلامة والأمن، والتي ينص عليها الأمر التنفيذي، قد تحد صدقية نماذج الذكاء الاصطناعي التي تتسلل بصورة مطردة إلى جميع جوانب الحياة الأميركية، من النقل والطب إلى التوظيف والمراقبة.

بعبارة أخرى، يمكن أن تساعد الانتخابات الرئاسية المقبلة على تحديد ما إذا كان الذكاء الاصطناعي سيصبح أداة استثنائية للإنتاجية، أو عامل فوضى لا يمكن السيطرة عليه.

الرقابة والمشورة جنباً إلى جنب

يتطرق الأمر التنفيذي الصادر عن بايدن إلى كل التفاصيل بدءاً باستخدام الذكاء الاصطناعي لتحسين الرعاية الصحية للمحاربين القدامى، وصولاً إلى وضع ضمانات لاستخدام الذكاء الاصطناعي في اكتشاف الأدوية. إلّا أنّ معظم الجدل السياسي، الذي يدور بشأن الأمر التنفيذي، ينبع من فقرتين في القسم الذي يتناول مخاطر الأمن الرقمي وتأثيرات السلامة في العالم الحقيقي.

ويشترط أحد هذه البنود على مالكي نماذج الذكاء الاصطناعي القوية تقديم تقارير إلى الحكومة بشأن كيفية تدريبهم للنماذج وحمايتها من التلاعب والسرقة، بما في ذلك تقديم نتائج "اختبارات الفريق الأحمر" المصممة للعثور على نقاط الضعف في أنظمة الذكاء الاصطناعي من خلال محاكاة الهجمات. ويوجه البند الآخر المعهد الوطني للمعايير والتكنولوجيا (NIST) التابع لوزارة التجارة إلى إصدار إرشادات تساعد الشركات على تطوير نماذج الذكاء الاصطناعي الآمنة من الهجمات السيبرانية والخالية من التحيز.

والعمل على هذه المشاريع جارٍ على قدم وساق. لقد اقترحت الحكومة شروطاً تتضمن إعداد تقارير ربع سنوية لمطوري الذكاء الاصطناعي، وأصدر المعهد الوطني للمعايير والتكنولوجيا وثائق توجيهية بشأن الذكاء الاصطناعي تتعلق بإدارة المخاطر، وتطوير البرمجيات الآمنة، والعلامات المائية للمحتوى الاصطناعي، ومنع إساءة استخدام النماذج، بالإضافة إلى إطلاق مبادرات متعددة لتعزيز اختبار النماذج.

ويرى الداعمون لهذه الجهود أنها ضرورية للحفاظ على الرقابة الحكومية الأساسية على قطاع الذكاء الاصطناعي سريع التوسع، وإيعاز المطورين لتحسين الأمن. أما بالنسبة إلى النقاد المحافظين، فإن شروط الإبلاغ تُعد تجاوزاً غير قانوني من جانب الحكومة من شأنه أن يحطم الابتكارات في مجال الذكاء الاصطناعي ويكشف الأسرار التجارية للمطورين، في حين أن توجيهات المعهد الوطني للمعايير والتكنولوجيا ما هي إلا حيلة ليبرالية لإصابة الذكاء الاصطناعي بمفاهيم يسارية متطرفة بشأن التضليل والتحيز، والتي ترقى إلى مستوى الرقابة على الخطاب المحافظ.

خلال تجمّع حاشد في سيدار رابيدز في ولاية أيوا، في كانون الأول/ديسمبر الماضي، انتقد ترامب الأمر التنفيذي الصادر عن بايدن، زاعماً، من دون دليـل، أن إدارة بايدن استخدمت الذكاء الاصطناعي بالفعل لأغراض شائنة.

وقال: "عندما يُعاد انتخابي، سأقوم بإلغاء الأمر التنفيذي الخاص بالذكاء الاصطناعي، والذي أصدره بايدن، وسأحظر استخدام الذكاء الاصطناعي لفرض رقابة على حرية تعبير المواطنين الأميركيين من اليوم الأول".

حيطة واجبة أم عبء غير ضروري؟

أثارت جهود بايدن الرامية إلى جمع معلومات بشأن كيفية تطوير الشركات واختبارها وحمايتها لنماذج الذكاء الاصطناعي الخاصة بها، ضجة في الكابيتول هيل بمجرد الإعلان عنها.

واستغل الجمهوريون في الكونغرس حقيقة أنّ بايدن برر المطلب الجديد من خلال تفعيل قانون الإنتاج الدفاعي لعام 1950، وهو إجراء في زمن الحرب يسمح للحكومة بتوجيه أنشطة القطاع الخاص لضمان إمدادات موثوقة من السلع والخدمات. ووصف المشرعون من الحزب الجمهوري خطوة بايدن بأنها غير ملائكة وغير قانونية وغير ضرورية.

بالإضافة إلى ذلك، انتقد المحافظون شروط الإبلاغ باعتبارها عبئاً على القطاع الخاص. وقالت النائبة نانسي ميس خلال جلسة استماع ترأستها في آذار/مارس بشأن "تجاوزات البيت الأبيض في مجال الذكاء الاصطناعي"، إن هذا البند "قد يخيف المبتكرين المحتملين ويعرقل مزيداً من الإنجازات على غرار ’تشات جي بي تي‘ (ChatGPT)".

وقال هيلبيرغ إنّ الشروط المرهقة تفيد الشركات القائمة وتضرّ الشركات الناشئة، وإنّ منتقدي وادي السيليكون يخشون أن تكون الشروط بمثابة "نقطة انطلاق" نحو نظام ترخيص يجب أن يحصل من خلاله المطورون على إذن من الحكومة لاختبار نماذجهم.

وأشار ستيف ديلبيانكو، الرئيس التنفيذي لمجموعة التكنولوجيا المحافظة " NetChoice"، إلى أنّ شرط الإبلاغ عن نتائج اختبار الفريق الأحمر يرقى إلى مستوى الرقابة الفعلية، علماً بأن الحكومة ستبحث عن مشاكل مثل التحيز والمعلومات المضللة. وقال في هذا الصدد: "أنا قلق تماماً بشأن إدارة اليساريين... التي ستؤدي اختبارات فريقها الأحمر إلى قيام الذكاء الاصطناعي بتقييد ما يولده خوفاً من إثارة القلق".

ويرى المحافظون أنّ أي قانون يقيد الابتكار في مجال الذكاء الاصطناعي سيكلف الولايات المتحدة غالياً في منافستها التكنولوجية مع الصين.

وقال هيلبيرغ: "إنهم عدوانيون للغاية، وقد جعلوا من السيطرة على الذكاء الاصطناعي عنصراً أساسياً في استراتيجيتهم حول كيفية القتال في الحروب والفوز بها. والفجوة بين قدراتنا وقدرات الصين تتقلص مع كل عام يمرّ".

معايير السلامة "الواعية"

من خلال تضمين الأضرار الاجتماعية في إرشاداته الخاصة بأمن الذكاء الاصطناعي، أثار المعهد الوطني للمعايير والتكنولوجيا غضب المحافظين وأطلق جبهة أخرى في الحرب الثقافية حول الاعتدال في المحتوى وحرية التعبير.

وانتقد الجمهوريون توجيهات المعهد الوطني للمعايير والتكنولوجيا باعتبارها شكلاً من أشكال الرقابة الحكومية المستترة. ومؤخراً، انتقد السيناتور تيد كروز ما أسماه "معايير "أمن" الذكاء الاصطناعي" الخاصة بـالمعهد الوطني للمعايير والتكنولوجيا لكونها جزءاً من "خطة إدارة بايدن لتقييد حرية التعبير" بناءً على الأضرار الاجتماعية "غير المتبلورة". وقد حذّرت شركة " NetChoice" المعهد الوطني للمعايير والتكنولوجيا من أنه يتجاوز سلطته من خلال المبادئ التوجيهية شبه التنظيمية التي تُخلّ بـ"التوازن المناسب بين الشفافية وحرية التعبير".

و يرفض الكثير من المحافظين بشكل قاطع فكرة أن الذكاء الاصطناعي قد يرسّخ الأضرار الاجتماعية، ويجب تصميمه بطريقة لا تتسبب بحدوث ذلك.

وقال هيلبيرغ في هذا الإطار: "إنه حل للبحث عن مشكلة غير موجودة فعلياً. إذ لم يكن هناك دليل كبير على وجود مشكلات في التمييز في مجال الذكاء الاصطناعي".

وكثيراً ما أظهرت الدراسات والتحقيقات أن نماذج الذكاء الاصطناعي تحتوي على تحيزات ترسّخ التمييز، بما في ذلك في مجالات التوظيف، والشرطة، والرعاية الصحية. كما تشير الأبحاث إلى أن الأشخاص الذين يواجهون هذه التحيزات قد يتبنونها بشكل غير مقصود.

ويشعر المحافظون بالقلق بشأن مبالغة شركات الذكاء الاصطناعي في تصحيح الأخطاء المتعلقة بهذه المشكلة أكثر من قلقهم بشأن المشكلة نفسها. وقد استشهد هيلبيرغ بقضية قديمة تتعلق بمنصة الذكاء الاصطناعي التوليدي من "غوغل" قائلاً: "توجد علاقة عكسية مباشرة بين درجة الوعي في الذكاء الاصطناعي وفائدة الذكاء الاصطناعي".

ويطلب الجمهوريون من المعهد الوطني للمعايير والتكنولوجيا التركيز على مخاطر السلامة المادية للذكاء الاصطناعي، بما في ذلك قدرته على مساعدة الإرهابيين في بناء أسلحة بيولوجية (وهو أمر يعالجه الأمر التنفيذي الصادر عن بايدن). وفي حال فاز ترامب في الانتخابات الرئاسية، فيُرجَح أن يقلل الأشخاص الذين عيّنهم تركيزهم على الأبحاث الحكومية حول الأضرار الاجتماعية للذكاء الاصطناعي. وقد اشتكى هيلبيرغ من أنّ "الكم الهائل" من الأبحاث حول تحيز الذكاء الاصطناعي أدى إلى تضاؤل الدراسات حول "التهديدات الكبرى المرتبطة بالإرهاب والحرب البيولوجية".

الدفاع عن "النهج المبسّط"

يقدم الخبراء في مجال الذكاء الاصطناعي والمشرعون دفاعات قوية عن أجندة بايدن المتعلقة بأمن الذكاء الاصطناعي.

وقال النائب تيد ليو، الرئيس المشارك الديمقراطي في فريق عمل الذكاء الاصطناعي التابع لمجلس النواب، إن هذه المشاريع "تمكن الولايات المتحدة من البقاء في طليعة" البلدان المطوّرة للذكاء الاصطناعي "مع حماية الأميركيين من الأضرار المحتملة".

وتعتبر شروط الإبلاغ ضرورية لتنبيه الحكومة إلى القدرات الجديدة التي يحتمل أن تكون خطيرة في نماذج الذكاء الاصطناعي القوية بشكل مطرد، بحسب مسؤول حكومي أميركي يعمل في قضايا الذكاء الاصطناعي. وأشار المسؤول، الذي طلب عدم الكشف عن هويته للتحدث بحرية، إلى اعتراف شركة "أوبن إيه آي" (OpenAI) بشأن "الرفض المتناقض لطلبات تصنيع العوامل العصبية" في نموذجها الأخير.

ووفقاً للمسؤول نفسه فإنّ شروط الإبلاغ ليست صعبة للغاية. وهم يرون أن الأمر التنفيذي الصادر عن بايدن، على عكس قوانين الذكاء الاصطناعي في الاتحاد الأوروبي والصين، يعكس "نهجاً واسعاً للغاية ومبسطاً يسهم في مواصلة تعزيز الابتكار".

وقد رفض نيك ريس، الذي شغل منصب أول مدير لقسم التكنولوجيا الناشئة في وزارة الأمن الداخلي من عام 2019 إلى عام 2023، الادعاءات المحافظة بأن شرط الإبلاغ سيهدد الملكية الفكرية للشركات. وقال إنّ هذا الأمر قد يفيد الشركات الناشئة من خلال تشجيعها على تطوير نماذج ذكاء اصطناعي "أكثر كفاءة من الناحية الحسابية" وأقل ثقلاً بالبيانات التي تندرج في إطار عتبة الإبلاغ.

وأشارت آيمي فيلدز ماير، التي ساعدت في صياغة الأمر التنفيذي الصادر عن بايدن بصفتها المسؤولة التقنية في البيت الأبيض، إلى أنّ قوة الذكاء الاصطناعي تجعل الرقابة الحكومية أمراً ضرورياً.

وقالت: "نحن نتحدث عن الشركات التي تقول إنها تبني أقوى الأنظمة في تاريخ العالم. والالتزام الأول للحكومة يتمثل بحماية الناس".

ويشيد الخبراء بالتوجيهات الأمنية للمعهد الوطني للمعايير والتكنولوجيا باعتبارها مورداً حيوياً لبناء وسائل حماية في التكنولوجيا الجديدة. كما يشيرون إلى أن نماذج الذكاء الاصطناعي الفاسدة قد تؤدي إلى أضرار اجتماعية خطيرة، بما في ذلك التمييز في الإيجارات والإقراض والفقدان الخاطئ للمنافع الحكومية.

في المقابل، يشترط الأمر الصادر عن ترامب الخاص بالذكاء الاصطناعي خلال ولايته الأولى أن تحترم أنظمة الذكاء الاصطناعي الفيدرالية الحقوق المدنية، وهو الأمر الذي سيتطلب بحثاً في الأضرار الاجتماعية.

وقد رحّب قطاع الذكاء الاصطناعي إلى حد كبير بأجندة بايدن المتعلقة بالأمن. وقال مسؤول أميركي في هذا الإطار: "ما نسمعه هو أنه من المفيد على نطاق واسع توضيح هذه الأمور". وبالنسبة للشركات الجديدة التي تتضمن فرقاً صغيرة، فإن ذلك "يساعد على مضاعفة قدرات موظفيها على معالجة هذه المخاوف".

وقال مايكل دانيال، المستشار السيبراني الرئاسي السابق الذي يترأس اليوم "تحالف التهديد السيبراني" (Cyber Threat Alliance) وهي منظمة غير ربحية لتبادل المعلومات، إنّ التراجع عن الأمر التنفيذي لبايدن يرسل إشارة مثيرة للقلق مفادها أن "حكومة الولايات المتحدة ستتبع نهج عدم التدخل في ما يتعلق بأمن الذكاء الاصطناعي".

أما بالنسبة للمنافسة مع الصين، فيقول المدافعون عن الأمر التنفيذي إنّ قواعد السلامة ستساعد الولايات المتحدة على الانتصار من خلال ضمان عمل نماذج الذكاء الاصطناعي الأميركية بشكل أفضل من منافسيها الصينيين وحمايتها من التجسس الاقتصادي لصالح بكين.

مساران مختلفان للغاية

في حال تمكن ترامب من دخول البيت الأبيض الشهر المقبل، فتوقعوا حدوث تغيير جذري في كيفية تعامل الحكومة مع أمن الذكاء الاصطناعي.

ويسعى الجمهوريون إلى الحد من أضرار الذكاء الاصطناعي من خلال تطبيق "قوانين الضرر والقوانين التشريعية القائمة" بدلاً من سن قيود جديدة واسعة النطاق على التكنولوجيا، كما يقول هيلبيرغ، ويفضلون "التركيز بشكل أكبر على تعظيم الفرص التي يوفرها الذكاء الاصطناعي، بدلاً من التركيز بشكل مفرط على التخفيف من حدة المخاطر". وبالتالي، يُحتمل أن يؤدي ذلك إلى القضاء على شروط الإبلاغ وربما على بعض توجيهات المعهد الوطني للمعايير والتكنولوجيا.

وقد تواجه شروط الإبلاغ أيضاً تحديات قانونية الآن بعد أن تساهلت المحكمة العليا مع الوكالات عند تقييم أنظمتها.

وقد تؤدي معارضة الحزب الجمهوري إلى تعريض شراكات اختبار الذكاء الاصطناعي التطوعية التي أبرمها المعهد الوطني للمعايير والتكنولوجيا مع الشركات الرائدة للخطر. فماذا هو مصير تلك الالتزامات في الإدارة الجديدة؟

وقد أدى هذا الاستقطاب حول الذكاء الاصطناعي إلى إحباط خبراء التكنولوجيا الذين يخشون أن يقوض ترامب السعي إلى إيجاد نماذج أكثر أماناً.

وقالت نيكول تورنر لي، مديرة مركز الابتكار التكنولوجي التابع لمعهد "بروكينغز": "تترافق الوعود في مجال الذكاء الاصطناعي مع الكثير من المخاطر؛ لذا، من الضروري أن يواصل الرئيس المقبل ضمان سلامة هذه الأنظمة وأمنها".

نقلته إلى العربية: زينب منعم.